Graphcore宣布其IPU支持阿里云深度学习开放接口标准ODLA

9月25日消息,2020云栖大会上,阿里云宣布对行业开源业界首个深度学习开放接口标准ODLA(OpenDeepLearningAPI)。阿里云在今年5月份的OCP全球峰会上首次对外公布ODLA接口标准,并宣布已率先在Graphcore等生态伙伴上获得支持。IPU是Graphcore为机器智能从零设计的AI处理器,通过ODLA接口,开发者可以在IPU上快速跑通AIMatrix的各类模型。

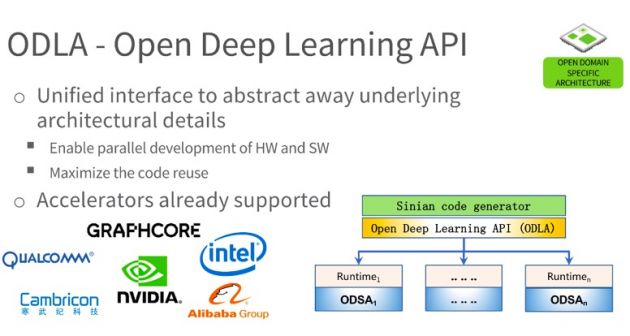

ODLA是一个为加速深度学习的统一异构硬件编程接口。ODLA规范了深度学习计算任务的定义和执行,实现上层应用和底层异构硬件平台的解耦,让AI异构计算更简单,实践代码“生成一次,随时链接,随处执行”的愿景。

Graphcore的联合创始人兼首席执行官NigelToon表示:“ODLA优雅地满足了Graphcore新用户的两个最大需求。一是他们希望轻松地将我们的技术集成到现有的数据中心,二是他们希望确保最终的设置在从各个组件到整个系统的每个层级都能得到高度优化。”

通过ODLA,在GraphcoreIPU上技术适配和应用部署的工作量可以实现大幅度降低,且实现效率大幅提升。另外,通过ODLA可以更好的与AI计算框架进行软硬协同,快速利用现有的编译优化技术,达到最佳性能。对于异构任务,ODLA充当该系统范围通用语言与特定于架构的优化之间的接口或转换器,该优化可从Graphcore的IPU等设备实现最佳性能。

附ODLA在2020云栖大会上宣布的主要特性:

"透明接口层,零损耗。

"接口抽象和统一,软硬件解耦:通过面向AI的多粒度算子抽象,定义统一的接口,解耦具体软硬件,平滑迁移业务;实现代码复用,提升开发和部署效率。

"多模态执行方式:支持多种执行模式,覆盖解释执行、编译执行、载入预编译代码等场景,兼容各种硬件的运行模式。

"AI全场景支持:支持推理和训练,适配云、边、端全场景AI业务;拥有广泛的算子定义和丰富的接口(设备管理、会话管理、执行管理、事件同步/异步、资源查询、性能监控等)。

"卓越的扩展性,支持AI芯片厂家独特属性和自定义算子。