Nvidia推出了经过改进的服务器GPU和新的Mellanox硬件

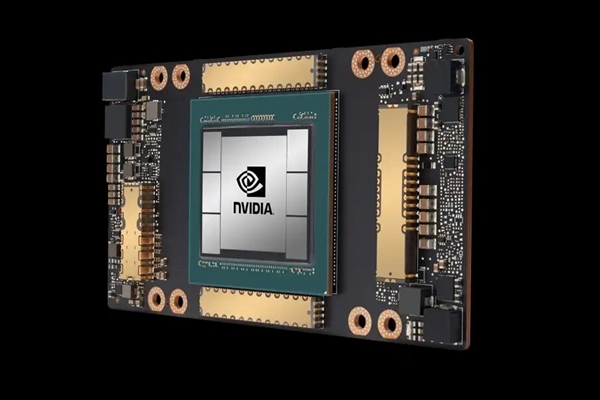

Nvidia旗舰产品A100服务器GPU的最新版本包装的高速内存是其前身的两倍。

在推出新的旗舰服务器GPU六个月后,Nvidia (NVDA)-Get Report 将对其进行内存升级,同时还将针对研究人员,超级计算机制造商和/或云巨头推出强大的硬件和网络解决方案。

英伟达的80GB A100 GPU该公司周一早上宣布,现在可以购买具有80GB高速HBM2e内存的Nvidia的A100服务器GPU(是以前的两倍)。

相比之下,英伟达最强大的游戏GPU GeForce RTX 3090和3080分别提供24GB和10GB GDDR6X图形内存。

除了单独出售外,还将通过Nvidia的DGX A100服务器和HGX A100服务器底板提供80GB A100,它们可以包装多达8个通过Nvidia专有的NVLink互连连接的A100 GPU。当然,它还将支持Nvidia的DGX SuperPod解决方案,以快速构建GPU加速的超级计算机。

Nvidia声称A100的内存提升功能可为各种AI模型训练,高性能计算(HPC)和数据分析工作负载显着提高性能,同时还改善了AI推理性能并使GPU更加节能。实际上,40GB A100是第一个基于Nvidia Ampere架构的GPU ,相对于其前身Tesla V100,它在训练,推理和传统HPC工作负载方面提供了巨大的性能提升。

DGX站A100Nvidia与80GB A100一起推出了DGX Station A100,这是一款功能强大的工作组服务器,适用于AI / HPC研究人员,借助先进的冷却系统,该服务器已放置在台式机中。DGX Station A100包含四个80GB或40GB A100 GPU,以及(呼应具有两个 示例的标准DGX A100)一个64核AMD (AMD)-获取报告Epyc服务器CPU。

宝马,洛克希德·马丁公司和日本移动运营商NTT Docomo将成为DGX Station A100的第一批购买者。这三家公司都计划使用服务器来帮助他们进行AI研究。

“通常,当客户想要构建超级计算机时,他们会对其进行计划,然后需要数月或数年的时间来构建。Nvidia的代表说,他们的用户首先要问的是,“什么时候可以得到第一个节点,以便我可以进行软件开发?”。“好吧...您可以[立即]得到第一个节点,因为[DGX Station A100具有]与要构建的超级计算机完全相同的GPU板。”

400-Gig Mellanox互连Nvidia的Mellanox服务器互连部门将推出一系列新产品-统称为NDR 400G InfiniBand系列-支持400 Gb / s InfiniBand连接。迄今为止,Mellanox最强大的InfiniBand产品已达到200 Gb / s的最高水平。

Mellanox的400千兆字节InfiniBand阵容预计将于2021年第二季度开始提供样品。正值这一时期,正如Nvidia首席执行官Jensen Huang强调的那样,网络连接经常成为服务器节点处理高要求AI的瓶颈。和GPU或其他加速器的帮助下的HPC工作负载。

NDR 400G InfiniBand系列产品包括400 gig适配卡和64端口交换机,承诺其交换机端口密度是其前一代产品的三倍。还有一个400千兆位数据处理单元(DPU),它将网络适配器功能与可以卸载各种网络,存储和安全处理功能的Arm CPU内核配对,以及可以处理400千兆位连接的铜缆和光收发器。

微软 (MSFT) -获取报表,它已经联手与Nvidia和Mellanox公司提供通过Azure云的按需访问的超级计算资源的情况下,表示将支持NDR 400G的InfiniBand线。在英伟达宣布收购Arm的两个月后以及英伟达概述了启动200g和最终400g的DPU并利用Arm CPU内核和集成芯片的宏伟计划之后的一个月,Mellanox的400千兆产品已被披露。GPU可以从服务器CPU卸载功能。

Nvidia仍然是AI培训和HPC /超级计算机加速器市场中的主导者,并且在新兴的AI推理服务器加速器市场中也扮演着重要角色。在超级计算机和云数据中心中,Mellanox的InfiniBand和以太网互连同样是常见的现象。

Nvidia的宣布是在SC20超级计算会议期间进行的,并在周三下午发布的10月季度收益报告之前。Nvidia高管将在美国东部时间周一下午6点进行SC20演示,以介绍其公司的最新产品。